-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年06月07日

可以来群一起交流我微信 lyfi2003

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年06月07日

不是没有原生的,是完全 exe 实现的 windows 的版本能力肯定不行,在 wsl 下才能发挥它的最大价值,我们把 wsl 的安装尽可能简化了,目前安装成功率是超过 90% 的。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年06月03日

有赖社区支持,最近 star 涨的可以。你是从哪些看到的周榜,我去瞅下。

-

早说了转语言了身体却很诚实... at 2026年05月23日

Rails 8 把架构简化到只依赖 PG,确实很神。

-

早说了转语言了身体却很诚实... at 2026年05月22日

go 只搞并发。比如处理 LLM 有关的流。不做任何业务管理。但它连数据库去做订单判断。

-

早说了转语言了身体却很诚实... at 2026年05月22日

我现在做的是 rails + go 两个直接做同仓库一个数据库共享。高并发的用 go。普通逻辑用 rails。再用上我们的 openclacky。完美。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月18日

在 settings 页添加新的。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月14日

对 session 一创建整个 agent 类型就定了。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月14日

写代码用可以用 Coding Agent(在创新新 session 旁边有个高级选项),或者直接用 CLI。实测能力跟 CC 对齐。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月13日

唉,应该不会呀,它是立刻打断处理新的任务。你能否成功提交上去了,还是卡在了输入提交上。可以在 github issues 上反馈一下具体情况

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月12日

看你这个提示 好像是 LLM 让它停下来了,没继续了。我建议你用最新的模型 比如 Qwen3.6 系列。过低的版本 Agent 能力不够。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月11日

没问题,我们后面更新一个。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月09日

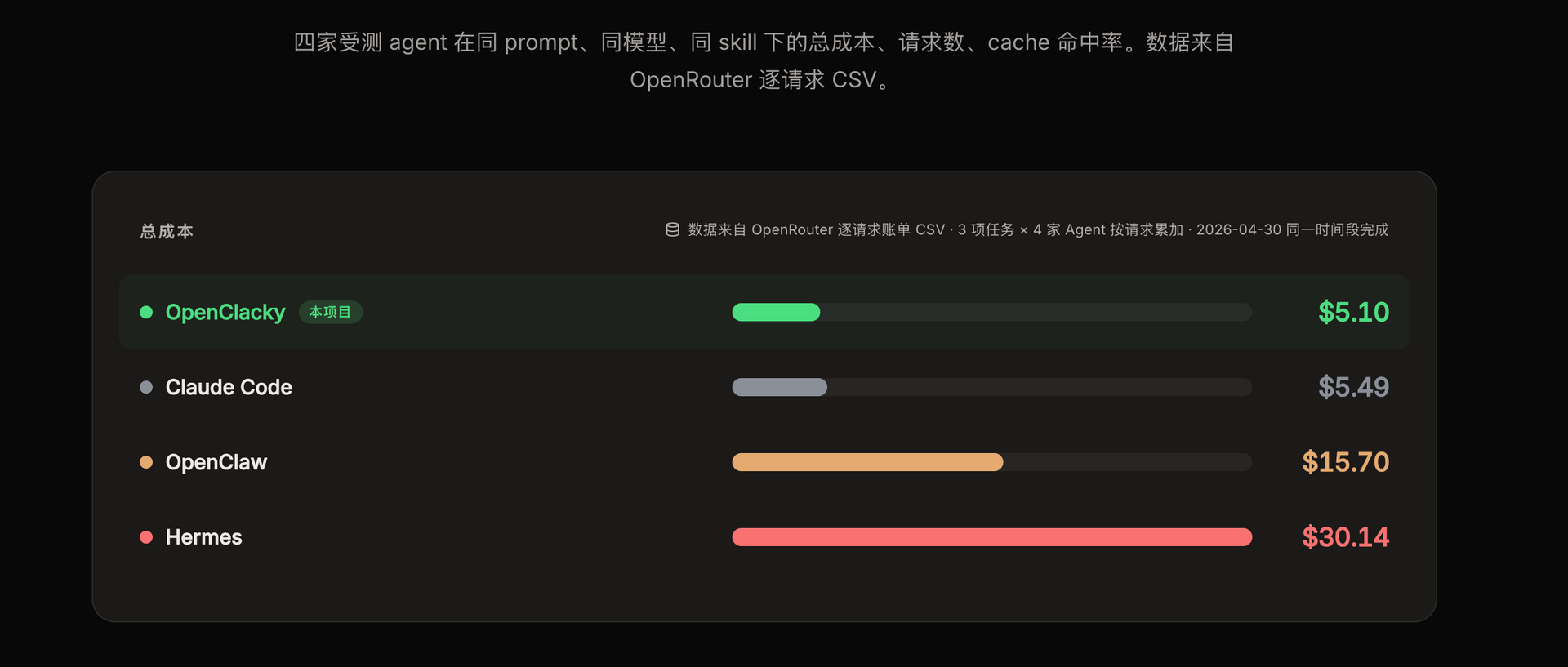

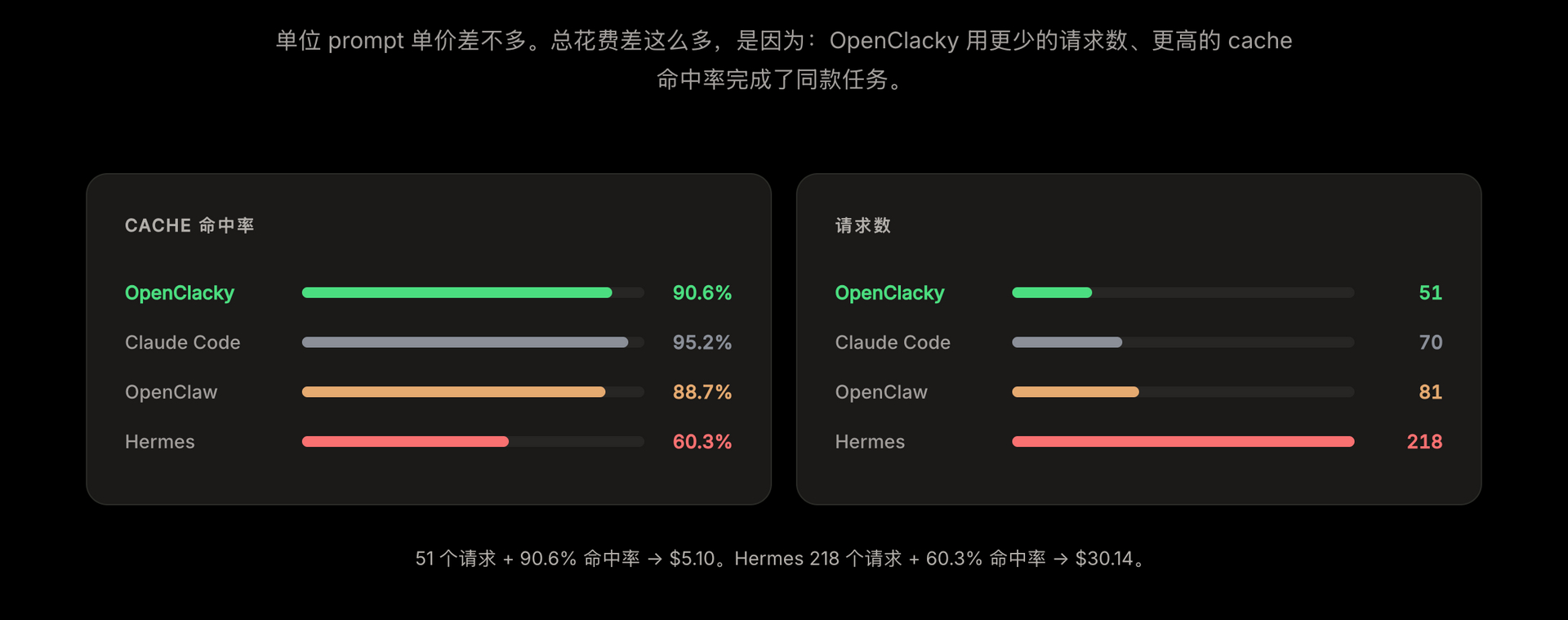

对比二:

同样 3 个任务,他们花了 30 美金,我们 5 美金。我们完成一个顶级 Agent 模向对比,到底离 ClaudeCode 顶级 Harness 还有多远,大家可以看看:https://www.openclacky.com/benchmark

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月09日

感谢反馈支持~ deepseek 那是地板价

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月06日

有 Ruby 的话直接 gem install openclacky 即可。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月02日

https://github.com/clacky-ai/rails-template-7x-starter

可以在这个项目上开新项目,效果很棒。

-

OpenClacky 1.0 正式发布 —— Ruby 圈第一个通用 Agent 来了 at 2026年05月02日

谢谢明圆

-

用 kamal 部署 rails 至阿里云主机总结 at 2026年04月13日

国内再做个加速

-

用 kamal 部署 rails 至阿里云主机总结 at 2026年04月13日

最简的方案是去布署到 railway 上面。

-

Ruby 的 TUI 庫 Ratatui-Ruby at 2026年01月22日

我推荐这个看看:https://github.com/marcoroth/bubbletea-ruby

博客:https://marcoroth.dev/posts/glamorous-christmas

但我研究完,发现还是 vibe 自己的更好

-

Ruby 新手,准备买点纸质书,大佬们看看这个清单是否合理。 at 2026年01月16日

Rails 官网的资料是最好的,结合项目深入看看。https://rubyonrails.org/docs

-

使用 https://gems.ruby-china.com 被拦截 at 2025年12月29日

找腾讯云反馈~

-

Ai 时代 结合现实的话诸君选择 ruby 还是 python at 2025年12月15日

-

支持 1-N 持续迭代。Clacky 可以理解是一个 AI 工程师,持续帮你优化和改进需求。

-

APP 生成能力近期刚上线,处于 beta 状态。标准的接口调用,路由,页面都比较顺利。

-

如果有前端业务需要,它会用 stimulus + turbostream 来实现,效果很出色

-

做了不少实验,整体原则是简单第一,可验证第二。早期用过 railsujs + js 组件化也工作的还行,目前结论是一套精简过的 turbo 架构。

-

Building, Deploying, and Monitoring Ruby Web Applications with Falcon (Kaigi on Rails 2025) at 2025年10月20日

每个 LLM 调用都要占一个完整的 Thread,一般来说要有十多秒,甚至 2 分钟。Rails + puma 最佳配置是 5 个 Thread。那并发能力可想而知。Asyncjob 也不推荐开太多 Thread。这种并发模型能力有限。

-

Building, Deploying, and Monitoring Ruby Web Applications with Falcon (Kaigi on Rails 2025) at 2025年10月16日

用 asyncjob 也不会太好

-

Building, Deploying, and Monitoring Ruby Web Applications with Falcon (Kaigi on Rails 2025) at 2025年10月16日

SSE 的话那更差了