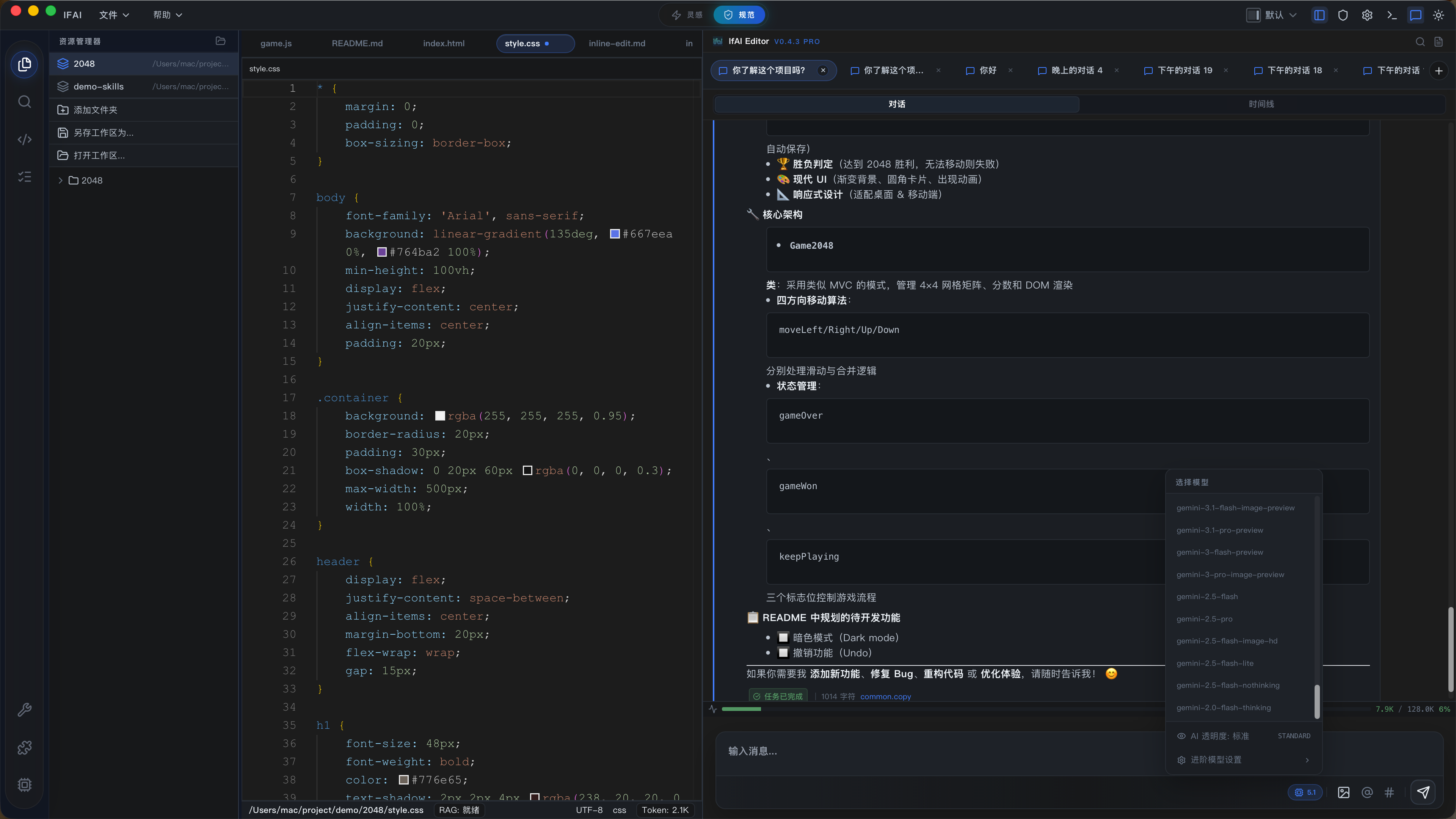

一份 YAML 文件搞定一家 AI 提供商。IfAI Editor v0.4.3 用元数据驱动架构同时接入 OpenAI、DeepSeek、智谱、Kimi、Gemini 五家大模型厂商共 53 个模型,一行配置即可扩展新 Provider。本文拆解其架构设计、多模态统一抽象、SSE 流解析关键 Bug 修复,以及国际化工程化实践。

五家 AI 大厂,一个编辑器

2026 年的大模型战场,没有一家通吃。

| 厂商 | 代表模型 | 优势场景 |

|---|---|---|

| OpenAI | GPT-5.4, O1, O3 | 最强推理、视觉理解、工具调用 |

| DeepSeek | DeepSeek V3.2 | 极致性价比,$0.028/千 Token |

| 智谱 AI | GLM-5.1, GLM-4.5V | 中文优化、视觉模型、Flash 高速推理 |

| Kimi(月之暗面) | K2.6, K2.5 | Thinking 思维链、256K 超长上下文、多模态 |

| Google Gemini | Gemini 3.1, 2.5 Pro | 百万级上下文、原生多模态、免费 API |

这五家提供商,协议各不相同:OpenAI 一套、Gemini 一套、DeepSeek 和 Kimi 虽然走 OpenAI 兼容格式但字段有差异。

做一个 AI 编辑器,最痛苦的事不是写前端 UI、不是做工具调用审批——是每接入一个新的 AI 提供商,就要手写 500 行适配代码。模型列表硬编码、请求格式手动转换、SSE 解析各写各的。

IfAI Editor v0.4.3 的核心目标只有一个:消灭这种重复。

元数据驱动:用 YAML 替代 500 行 Rust 代码

我们的方案是元数据驱动的 Provider 架构。每个 AI 提供商不再需要手写 Rust 客户端,而是用一个 YAML 文件描述全部信息:

metadata:

id: kimi-official

name: Kimi 官方

provider_type: ai

api_spec:

base_url: https://api.moonshot.cn/v1

endpoint: /chat/completions

auth:

type: bearer_header

header_name: Authorization

format: "Bearer {key}"

models:

- id: kimi-k2.6

name: Kimi K2.6

context_tokens: 256000

capabilities: [tools, streaming, vision, thinking, json_output]

后端通过 Rust 的 generate_provider_client! 宏,在编译期自动生成客户端代码。前端读取同一份 YAML 配置,自动渲染 Provider 选择界面和模型列表。

效果:

| 指标 | 重构前 | 重构后 |

|---|---|---|

| 单个 Provider 代码量 | ~500 行 | ~150 行 |

| 接入新 Provider 耗时 | 数天 | 数分钟 |

| 重复代码率 | ~95% | ~0% |

多模态:一张图、一个 PDF、一段代码,怎么统一?

多模态输入是 2025 年 AI 编辑器的标配。但不同提供商的多模态传输格式完全不同:

- OpenAI:

content: [{type: "image_url", image_url: {url: "base64..."}}] - Gemini:

inline_data: {mime_type: "image/png", data: "base64..."} - Kimi/DeepSeek:走 OpenAI 兼容格式,但支持的字段有差异

IfAI v0.4.3 的做法是统一内容抽象——所有输入被归一化为 MultimodalContent 格式:

// 统一的多模态内容表示

interface MultimodalContent {

type: 'text' | 'image' | 'pdf' | 'code';

content: string;

metadata?: {

filename?: string;

language?: string;

mimeType?: string;

size?: number;

};

}

// 发送时,FormatAdapter 自动转换为各提供商格式

const message = [

{ type: 'text', content: '分析这张架构图' },

{ type: 'image', content: 'data:image/png;base64,...' },

{ type: 'code', content: 'fn main() { ... }',

metadata: { filename: 'main.rs', language: 'rust' } }

];

前端还实现了智能粘贴检测——用户粘贴截图、拖拽文件时,自动识别内容类型并转换为多模态格式。图片超过 5MB 自动压缩,相同图片 Base64 只编码一次(缓存命中省 40% 内存)。

那个让所有 Provider 都罢工的 SSE Bug

这是 v0.4.3 修复的最关键 Bug,影响所有 OpenAI 兼容提供商。

问题出在 SSE 流解析的 finish_reason 判断:

// Bug:finish_reason: null 也被判定为 finish 事件

let is_finish_event = json.get("finish_reason").is_some();

// 结果:所有内容事件被跳过,用户收到空响应

JSON 中 finish_reason: null 意味着"流还没结束",但 Rust 的 json.get("finish_reason").is_some() 对 null 值也返回 true——于是每个 content chunk 都被错误识别为结束事件。

修复:

// 正确:null 不会通过 as_str()

let is_finish_event = json.get("finish_reason")

.and_then(|v| v.as_str())

.is_some();

一行修复,解决 Kimi、DeepSeek、智谱、OpenAI 以及所有使用 OpenAIFormatAdapter 的提供商的流式响应问题。

Kimi K2 的 Thinking 模式:双重内容流

Kimi K2 系列有个独特功能——SSE 流中同时返回思考过程和最终响应:

{

"choices": [{

"delta": {

"reasoning_content": "让我分析一下用户的需求...",

"content": "根据您的需求,建议如下..."

},

"finish_reason": null

}]

}

IfAI v0.4.3 自动识别 reasoning_content 字段,将思考过程和正式响应分流显示。用户可以查看模型的"思维链",同时获得干净的回答。

53 个模型,各有所长

v0.4.3 共接入 5 家提供商、53 个模型,覆盖从轻量到旗舰的全系列:

OpenAI(15 个模型):从 GPT-3.5 Turbo 到 GPT-5.4,覆盖 O1/O3 推理系列。GPT-5.4 和 O3 支持最长 200K 上下文,适合复杂代码审查和长文档分析。

DeepSeek(1 个模型):DeepSeek Chat V3.2,128K 上下文,支持工具调用和函数调用。关键是价格——缓存命中仅需 $0.028/千 Token,是日常编码助手的最佳选择。

智谱 AI(11 个模型):GLM-5.1 为最新旗舰,GLM-4.5V 提供视觉理解能力,GLM-4.7 Flash 提供高速推理。中文场景表现突出,GLM-3 Turbo 提供 32K 上下文的轻量选择。

Kimi(12 个模型):K2.6 为最新旗舰,支持 Thinking 模式和 256K 超长上下文。K2 Thinking 系列专门用于复杂推理,V1 系列提供 8K/32K/128K 三种上下文选择,还有 Vision Preview 版本支持图片理解。

Gemini(15 个模型):从 1.5 到 3.1 三代产品。Gemini 1.5 Pro 拥有 2.8M 超长上下文(行业最长),3.1 系列支持图像生成预览。全部模型支持 1M 以上上下文,适合处理大型代码库和长文档。

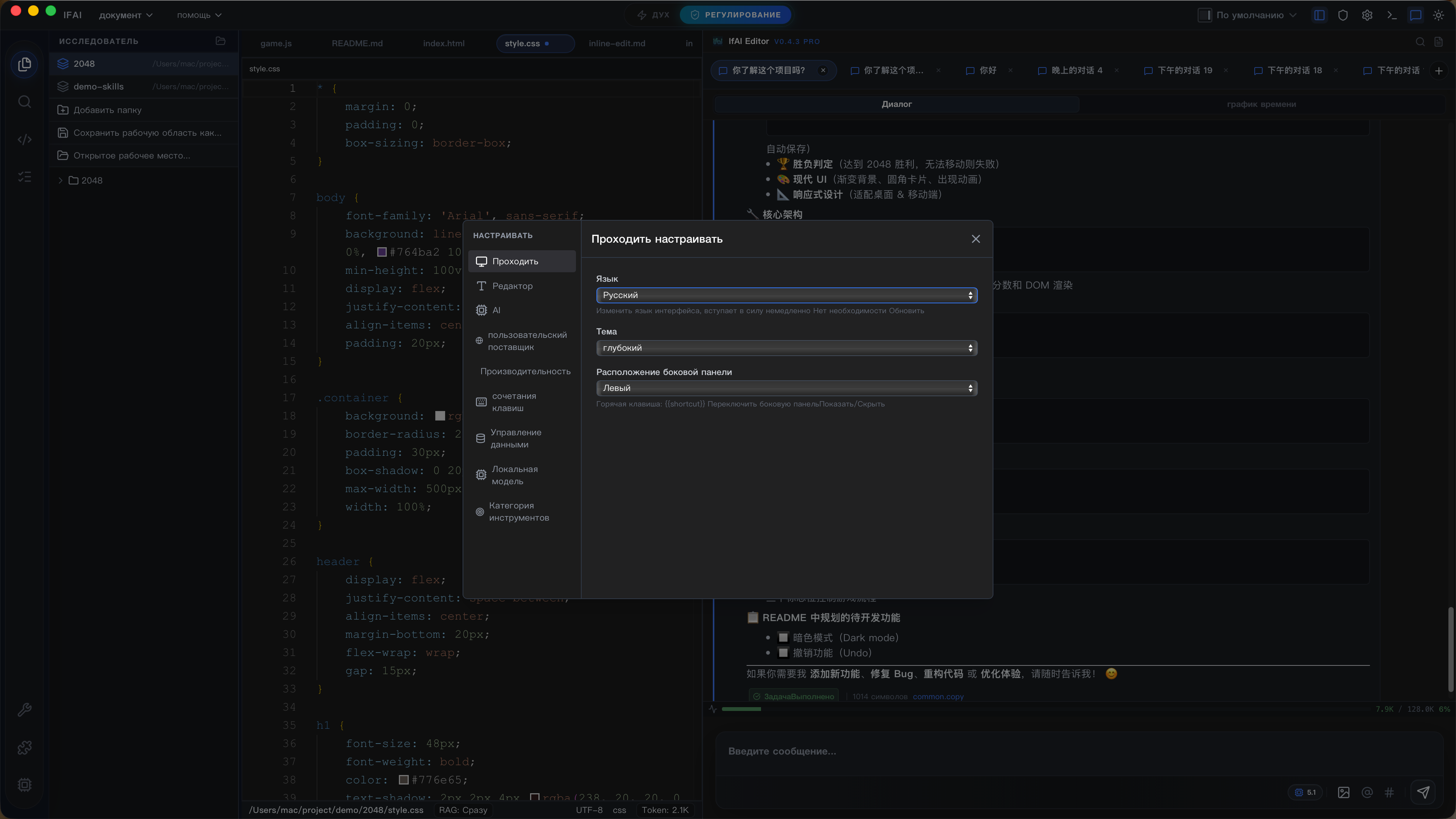

国际化工程化:2749 个键,三种语言,怎么保证一致性?

v0.4.3 新增俄语支持,现在覆盖中/英/俄三种语言,共 2749 个翻译键。

真正的难点不是翻译本身,而是一致性保障。2749 个键分布在 3 个 JSON 文件中,手动对齐几乎不可能出错。

我们用工程化手段解决:

-

自动化校验脚本:

check-i18n-parity.mjs在每次 commit 时自动比对三个语言文件的键集合,发现不一致直接阻止提交(退出码 1) -

硬编码扫描:

scan-hardcoded-strings.mjs扫描源码中未走 i18n 的中文硬编码 -

Pre-commit Hook:husky + lint-staged,修改

locales/*.json时自动触发校验 - CI 门禁:GitHub Actions 中 TypeScript 类型检查 + i18n 一致性校验 + 单元测试三道关卡

数据总览

v0.4.3 版本的工程数据:

| 指标 | 数据 |

|---|---|

| AI 提供商 | 5 家(OpenAI、DeepSeek、智谱、Kimi、Gemini) |

| 模型总数 | 53 个 |

| 最长上下文 | 2.8M (Gemini 1.5 Pro) |

| 最短上下文 | 8K (GLM-3 Turbo, Moonshot V1 8K) |

| 支持视觉 | 4 家(OpenAI、智谱、Kimi、Gemini) |

| 支持工具调用 | 5 家(全部) |

| 支持 Thinking | 2 家(OpenAI O1/O3、Kimi K2) |

| 协议 | OpenAI Standard(4 家)+ Gemini Custom(1 家) |

| i18n | 2,749 键,中/英/俄 100% 对齐 |

| 测试 | 1155 单元测试通过,417 E2E 测试零失败 |

| 代码变更 | +5,500 / -2,000 行 |

写在最后

AI 编辑器的竞争,正在从"能不能用"转向"好不好接"。

元数据驱动架构的核心思想其实很简单:把变化的部分从代码中抽离出来,变成数据。Provider 会越来越多,模型会越来越快,协议会不断演进——但只要描述这些变化的元数据格式稳定,代码就不用改。

这是 v0.4.3 最重要的架构决策:让配置做配置的事,让代码做代码的事。

*IfAI Editor 是基于 Tauri 2.0 + Rust 构建的跨平台 AI 代码编辑器,开源地址见 GitHub。 *